随着 Agent 承担越来越复杂的长期任务,一个现实的工程瓶颈逐渐浮出水面:LLM 的上下文窗口有限,Token 成本高昂,而每次对话结束后,所有的交互信息都会随 Session 消失。

记忆系统正是为了解决以上痛点而诞生的基础设施——它让 Agent 不仅能在单次对话中保持连贯性,还能跨越多个 Session 积累用户偏好和历史经验,从“一次性工具”进化为“长期协作伙伴”。

文章概览:

Agent 的记忆系统是如何设计的?

工业界通常将记忆系统划分为两个物理与逻辑隔离的层级:短期记忆(Session 级)与长期记忆(跨 Session 级)。

记忆的存储形式

除了按时间维度划分,记忆还可以按存储位置与表征形式分为三类:

| Token 级记忆 | ||

| 参数化记忆 | ||

| 潜在记忆 |

这三种形式可以相互转换。例如 MemOS 提出的“记忆立方体”框架支持:纯文本记忆 → 激活记忆(KV Cache)→ 参数记忆(通过蒸馏固化到模型) 的动态流转,实现“热记忆”到“冷记忆”的分级管理。

记忆的功能分类

按功能目的,Agent 记忆分为三类:

| 事实记忆 | |||

| 经验记忆 | |||

| 工作记忆 |

按内容性质进一步细分:

• 情景记忆(Episodic Memory):记录特定时间、场景下的具体事件,回答"What happened?"。例如:“上周三用户反馈订单超时问题”。 • 语义记忆(Semantic Memory):从多个情景中提炼的通用知识、事实或规律,回答"What does it mean?"。例如:“该用户对性能问题敏感度高于功能需求”。 • 程序记忆(Procedural Memory):存储技能、规则和习得行为,使 Agent 能自动执行任务序列而无需每次显式推理。例如:“处理该用户的代码审查时,优先检查 OOM 风险”。

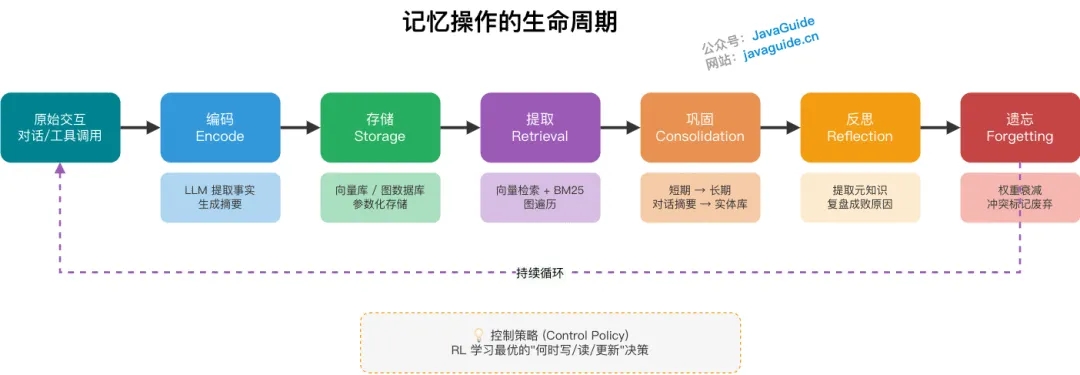

记忆操作的生命周期

记忆系统是一个动态演化的有机体。其生命周期包含以下核心操作:

编码(Encode) → 存储(Storage) → 提取(Retrieval) → 巩固(Consolidation) → 反思(Reflection) → 遗忘(Forgetting)

| 编码 | ||

| 存储 | ||

| 提取 | ||

| 巩固 | ||

| 反思 | ||

| 遗忘 |

前沿趋势:记忆控制策略(Control Policy)成为新维度

最新的记忆系统综述将控制策略列为与时间跨度、表征形式并列的三大维度之一。核心问题是:“何时写、何时读、何时更新?”传统的记忆系统采用规则触发(如每轮对话后写入),而前沿方案正尝试通过强化学习让 Agent 学习最优的控制策略——例如,判断当前信息是否值得写入、何时触发记忆更新、何时主动遗忘。这种端到端的记忆管理使 Agent 能够根据任务特点自主调整记忆行为,避免依赖硬编码规则。

短期记忆(Short-Term Memory / Working Memory)

概念:Agent 在当前单次会话(Session)中持有的暂存信息,涵盖用户的提问、模型的每轮回复,以及工具调用的中间结果(Observations)。短期记忆直接作为 Prompt 的组成部分参与 LLM 当前轮次的推理,是 Agent 感知“当前任务上下文”的唯一来源。

实现方式:依托 LLM 自身的上下文窗口(Context Window)。主流模型的窗口已显著扩展:GPT-5 支持 400K Token,Claude Sonnet 4.6 支持 1M Token,Gemini 3 Pro 支持 1M Token,Llama 4 Scout 支持 10M Token,Grok 4 支持 2M Token(截至 2026 年数据)。需注意:上下文窗口属于高频变更指标,上述数字请以各模型官方 model card 或 API 文档的最新发布为准。

然而更长的窗口并不意味着可以无限堆砌上下文——推理成本随 Token 数线性增长。《Lost in the Middle》研究表明,在多文档检索型任务中,模型对位于上下文首尾位置的信息利用率显著高于中间段。这一位置偏差在窗口越长时越明显,需要在上下文工程中主动控制输入信息的分布。

上下文工程策略(Context Engineering):为控制短期记忆的膨胀,框架层通常在运行时采用以下三类压缩策略:

• 上下文缩减(Context Reduction):当对话历史达到预设 Token 阈值时,框架自动丢弃最早的 N 轮消息(滑动窗口),或调用轻量模型将历史对话总结压缩,以最小的信息损耗换取上下文空间。 • 上下文卸载(Context Offloading):工具或 Skill 调用可能返回大体量数据(如完整网页 HTML、CSV 文件内容),此时将这些“重型结果”卸载到外部临时存储,Prompt 中只保留极短的引用标识(UUID 或文件路径)。当模型需深挖细节时,通过强制关联的 Function Calling 触发内部工具执行读取动作。同时需为该动作设置防雪崩策略:若读取超时或文件超限,工具应主动返回截断或降级响应。 • 上下文隔离(Context Isolation):在多智能体架构中,主 Agent 在向子 Agent 分配子任务时,只传递精简的任务指令和必要的上下文片段,避免将整个对话历史广播给每个子 Agent。这是控制多 Agent 系统总 Token 消耗的关键工程实践。

长期记忆(Long-Term Memory)

概念:跨越单个 Session 的持久化知识与经验库。与短期记忆不同,它不随对话结束而销毁,而是通过主动的“写入-检索”机制,使 Agent 能在全新的 Session 中调取历史沉淀的用户偏好、事实认知和过往经验。

实现原理(Record & Retrieve 双向交互):

• 记忆写入(Record):对话结束后,框架触发后台异步任务,调用 LLM 对本轮短期记忆进行语义“提纯”——过滤冗余的对话噪声,抽取高价值的结构化事实(例如:“用户的技术栈偏好为 Python + FastAPI”、“用户的汇报对象是 CFO,需要非技术化的表达风格”),以结构化条目的形式写入持久化存储。写入链路应视为**尽力而为(Best-Effort)**操作——LLM 提取可能遗漏关键事实或误将假设性陈述固化为偏好。写入操作本身也需设计幂等 Key 以防重试产生重复记忆;在 LLM 抽取场景下,幂等 Key 应基于源消息 ID + 抽取批次 ID,而非抽取结果文本(因温度采样或 prompt 微调可能导致语义相同但字面不同的表述,字符串哈希无法保证幂等)。在多端并发对话场景下,实体库合并与覆盖必须引入乐观锁或版本控制(MVCC)机制。 • 记忆检索(Retrieve):在新 Session 开始时,用户 Query 被向量化,与长期记忆库中的条目进行语义相似性检索,将最相关的历史偏好和背景知识注入到当前 Session 的 System Prompt 中,使 Agent 在对话伊始就具备“了解这位用户”的上下文感知能力。由于检索发生在首次响应的关键路径上,VectorStore 的 P99 延迟会直接叠加到 TTFT(Time to First Token),生产中通常采用预检索缓存(用户建立连接时将基础偏好全量加载至内存数据库如 Redis 形成预热缓存)来缓解这一开销,而对于依赖具体对话意图的深度记忆,则将向量检索与首 Token 生成进行流水线化重叠(如检索完成后立即开始生成首段,后台并行精排),使两部分耗时在用户感知上并行叠加,从而降低整体 TTFT。

长期记忆与 RAG(检索增强生成)的区别:

两者底层技术高度相似(均依赖向量库和语义检索),但服务对象不同:

• RAG 挂载的是共享知识源——公司规章、产品文档、实时数据库查询结果等,与“谁在使用”无关,对所有用户返回同一知识库的内容。其核心特征是非个性化,而非一定是静态的。 • 长期记忆管理的是 Agent 与特定用户交互中动态沉淀的个性化经验——用户的偏好、习惯、历史决策、专属背景,高度个性化,因人而异。 两者并非二选一,而是协作关系:RAG 提供“世界知识”(公司规章、产品文档),长期记忆提供“用户画像”(偏好、习惯、历史决策)。检索阶段可分别召回后融合排序;长期记忆中的实体可作为 RAG 检索的 query 扩展;用户偏好可作为 RAG 结果的个性化重排信号。

⭐️ 记忆系统的主流技术架构有哪些?

由于长期记忆涉及向量化存储、语义检索和记忆管理等复杂逻辑,通常将其剥离为独立的第三方组件。

底层存储架构

其底层架构通常由以下三层组成:

• VectorStore(向量数据库):将提取的记忆文本转化为语义向量(Embeddings)存储。以单节点 Qdrant(1.x 版本)、本地 SSD、HNSW 索引 ef=128、Recall@10 ≥ 0.95 为基准,在低并发场景(如 QPS 小于 50)下,P99 延迟可控制在数十毫秒级别。不同产品(Pinecone Serverless vs 自建 Qdrant vs Milvus)在相同 QPS 下 P99 差异可达 5-10 倍,实际选型请参考 ann-benchmarks.com[1] 或各厂商 benchmark 报告。常见方案包括 Pinecone、Weaviate、Chroma、Qdrant 等。 • GraphStore(图数据库):进阶方案,将记忆以“实体-关系”的形式建模为知识图谱(如 Neo4j),适用于需要多跳推理的复杂查询场景,例如“用户提到的同事 A 与项目 B 之间有什么关联”。 • Reranker(重排序器):向量检索的初步召回结果在语义相关性上并不精确有序,Reranker 基于交叉编码器(Cross-Encoder)对召回结果进行二次精排,显著提升最终注入上下文的记忆质量。

向量库选型核心维度:

LLM 事实抽取的失败模式与防御手段:LLM 提取可能遗漏关键事实或误将假设性陈述固化为偏好。工程上建议:

• Schema 约束:强制 JSON Schema 定义 + 重试机制兜底 • 置信度过滤:LLM-as-Judge 二次校验,置信度低于阈值的结果不写入 • 假设性语句识别:Prompt 中添加“假设性语句识别”指令(如"I might..."类陈述不固化) • 人工 Review 队列:高 importance 记忆触发人工审核流程 • 抽取审计日志:保留原始对话 + 抽取结果对照,便于回溯

主流 Memory 产品对比

2025 年被视为 Agent 市场元年,Agent Memory 领域涌现出多个代表性产品,各有其技术特色:

| Mem0[2] | |||

| LETTA (原 MemGPT) | |||

| ZEP | |||

| A-MEM | |||

| MemOS | |||

| MIRIX |

代表性方案详解

LETTA 的虚拟内存模型:借鉴操作系统分页思想,将 Context 划分为 Main Context(系统指令 + 工作上下文 + FIFO 队列)和 External Context(持久化存储)。当 Main Context 空间不足时,通过递归摘要(Recursive Summary)将旧消息压缩后换出到外部存储。这本质上是一种以牺牲信息颗粒度为代价的有损压缩方案——长周期的递归会导致精准事实(如 API 密钥、具体的报错堆栈、精确数值)严重降维甚至丢失,Agent 可能患上“技术性失忆症”。

ZEP 的三层知识图谱:

1. 情景子图:无损存储原始输入数据(消息、问题、JSON) 2. 语义子图:提取实体和关系,构建知识网络 3. 社区子图:对强连接实体聚类,生成高层次概括(参考 GraphRAG)

其核心创新是边失效机制:当新事实与旧事实存在时间重叠的矛盾时,标记旧边为“失效”并记录失效时间,既保留最新事实,也支持历史回溯。

MemOS 的记忆动态转换:

纯文本记忆 ──(高频使用)──→ 激活记忆(KV Cache) ──(长期固化)──→ 参数记忆(LoRA)

↑ │

└──────────────(知识过时/卸载)─────────────────────────────┘这种设计使“热记忆”(高频访问)可以预加载为 KV Cache 大幅降低 TTFT。而“核心记忆”则通过触发离线的 SFT(监督微调)流水线,蒸馏内化为特定用户的 LoRA 适配器——这并非实时的内存操作,而是需要收集高质量训练数据并启动离线 GPU 训练任务。更需注意的 trade-off 是:参数化记忆一旦烧入 LoRA,遗忘和纠错变得极其昂贵——不像向量库可以软删除一条记录,LoRA 的局部知识修改是开放研究问题(Machine Unlearning),业界尚无成熟方案。因此建议仅对极稳定的、几乎不会变更的核心偏好(如用户的汇报风格、长期偏好)才烧入参数。在多租户生产环境中,还需依赖支持动态 LoRA 卸载与加载的推理基建(如 vLLM 或 TGI)才能实现特定用户上下文的永久保留。

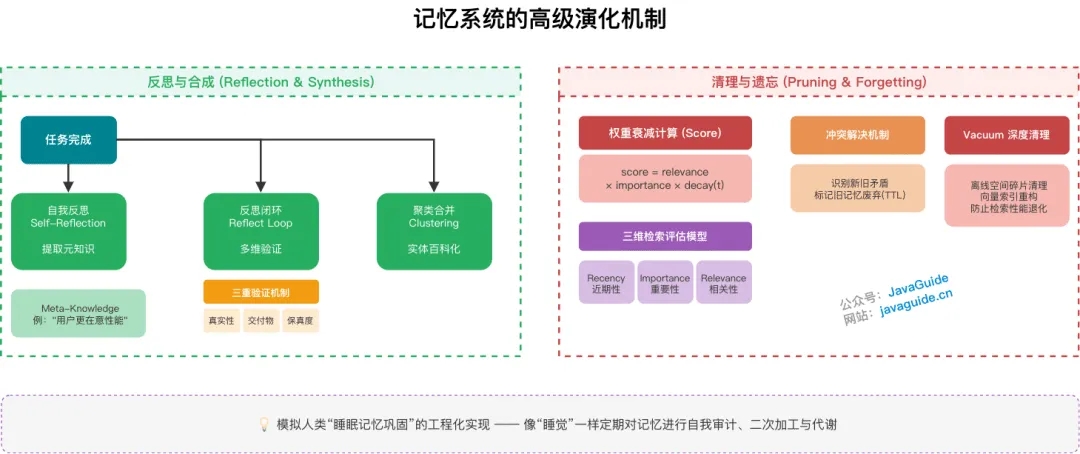

⭐️ 记忆系统的高级演化机制有哪些?

在基础的写入与检索之上,生产级 Agent 系统还需要一套 代谢机制 ,来保证记忆的质量与检索的信噪比。

记忆反思与合成(Reflection & Synthesis)

核心问题:Agent 如何从“原始数据”向“高阶知识”转化?

Agent 不仅仅是被动地记录原始对话,还需要像人类“睡觉”一样,定期对记忆进行自我审计和二次加工。

实现方式:

1. 自我反思(Self-Reflection):在任务完成后,Agent 启动一个异步任务,复盘本次任务的成败原因,并将“教训”提取为一条 Meta-Knowledge(元知识)。这一机制最早由 Park et al.(2023)《Generative Agents》论文系统化提出,是模拟人类“睡眠记忆巩固”过程的工程化实现。 例如:“在处理该用户的 Java 代码审查时,他更在意性能而非规范,未来应优先关注 OOM 风险。”

2. 精细化反思闭环(Reflect Loop):2025-2026 年的前沿框架(如 MUSE)已将反思机制演化为更精细的**“规划-执行-反思-记忆”闭环**。反思不再仅发生在任务完成后,而是在每个子任务结束时都会触发。独立的 Reflect Agent 会对子任务输出进行三重验证: 通过这种细粒度的反思,可以有效防止错误在多轮推理中累积放大。

• 真实性验证:输出是否符合客观事实 • 交付物验证:是否完成了用户指定的目标 • 数据保真性验证:关键数据是否在传递过程中丢失或变形 3. 记忆聚类与合并(Clustering & Consolidation):当长期记忆中出现大量碎片化、重复的记录时(例如用户 10 次提到了同一个项目背景),系统会自动触发合并任务,将这些碎片合成为一个完整的“实体百科”,减少向量库的冗余并提升检索的一致性。

记忆的清理与遗忘机制(Pruning & Forgetting)

核心问题:如何避免“记忆爆炸”和“过时记忆干扰”?

记忆并非越多越好。无用的噪声记忆和过时的错误信息会显著干扰 LLM 的判断。

工程策略:

• 权重与衰减(Importance & Decay):为每条记忆维护综合得分 score = relevance × importance × decay(t),其中relevance为当前 Query 与记忆条目的语义相似度(如余弦相似度),importance为记忆的固有重要性评分,衰减函数decay(t)通常取指数形式(如e^{-λt},λ 为衰减速率)。这一设计参考了《Generative Agents》中提出的三维检索模型:将近期性(Recency)、重要性(Importance)、相关性(Relevance)合并为综合权重。为避免查询时全量计算时间衰减造成的性能雪崩,工程上通常采用“读时粗滤 + 重排精算”策略:向量库仅负责静态语义召回,在随后的 Reranker 阶段,再对召回的 Top-K 结果实时应用该公式进行动态调整。• 主动冲突解决:当新旧记忆发生逻辑冲突时(如用户去年用 Java 8,今年升级到了 Java 21),系统需识别并标记旧记忆为“废弃状态”,防止 Agent 给出过时的建议。工程实现上,由于主流向量库(如 HNSW 索引)处理软删除(Soft Delete)会引发图索引连通性退化,需要定期执行离线 Vacuum(空间清理与图重构) 任务,避免废弃记录拉低检索性能。

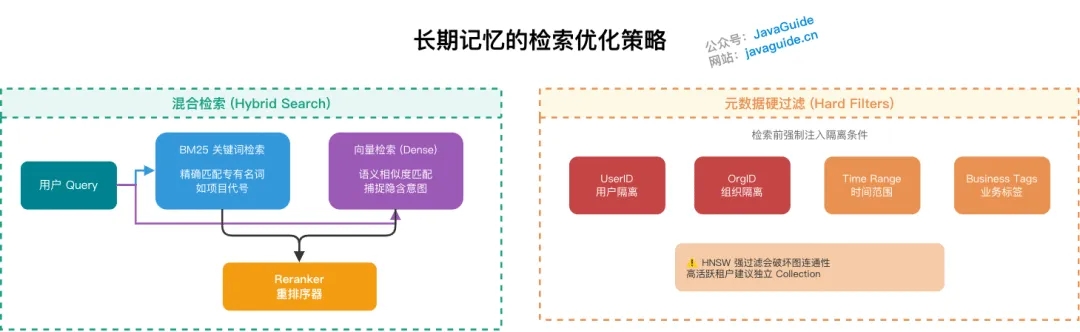

⭐️ 如何优化长期记忆的检索精度?

在 VectorStore 和 GraphStore 之外,生产环境下通常还需要一层“混合检索”策略。

混合检索与元数据过滤(Hybrid Search & Metadata Filtering)

核心问题:单纯依赖向量检索为什么会产生“虚假关联”?

单纯依赖向量的语义相似度(Dense Retrieval)有时会产生“虚假关联”。

• 混合检索(Hybrid Search):结合传统的关键词检索(BM25/Sparse)与语义向量检索(Dense)。融合算法可针对不同 query 类型动态调整权重(如专有名词查询加大 BM25 权重,模糊意图查询加大向量权重),常见融合方式包括: • RRF(Reciprocal Rank Fusion):无调参,适合冷启动,按排名倒数加权融合 • Linear weighted(α·dense + (1-α)·sparse):可调但需要标注数据校准权重 • Cross-encoder Reranker 兜底:召回阶段取并集,精排阶段统一打分,对长尾 query 效果显著 • 元数据硬过滤(Hard Filters):在进行向量检索前,先基于 UserID、组织 ID、时间范围或业务标签进行硬过滤。这是多租户场景下最关键的数据隔离手段——若缺失,“张三的偏好被推给了李四”将演变为严重的隐私合规事故。建议在数据访问层强制注入隔离条件,而非依赖调用方传参。但此处存在工程权衡:在基于 HNSW 算法的向量库中,如果在海量图谱中对少数租户标签进行强过滤,极易破坏图结构的连通路径导致召回率骤降。对于高活跃的核心租户,更稳妥的做法是分配独立的 Collection 进行物理隔离。

检索方法优于写入策略(Retrieval Trumps Writing)

在记忆系统中,检索方法的选择对性能的影响远大于写入策略。Mem0 在 LoCoMo 上达到 91.6(较旧算法 +20 分),LongMemEval 上达到 93.4(+26 分),BEAM (1M) 上 64.1,平均每次检索仅消耗约 7K Token(对比全上下文方案 25K+)。这些数字反映的是新旧算法的整体效果对比,详见 Mem0 官方 benchmark 文档[3]。

实验普遍表明,投入资源优化检索链路(Reranker、混合检索、图遍历)的 ROI 远高于优化写入链路。

⭐️ 生产级记忆系统需要哪些架构特性?

| 多维索引 | ||

| 隐私合规 | ||

| 冷热分离 |

这套完整的记忆系统架构,使 Agent 能够像人类一样:短期记忆保持连贯,长期记忆积累经验,反思机制持续优化,遗忘机制过滤噪音——这是从“工具”进化为“数字协作伙伴”的基础能力。

一个设计良好的记忆系统应能回答三个核心问题:

1. 智能体知道什么?(事实记忆 → 保持一致性) 2. 智能体如何改进?(经验记忆 → 持续学习) 3. 智能体当前思考什么?(工作记忆 → 上下文管理)

这三种能力的协同,使 Agent 从“即时反应”进化为“经验驱动的智能体”——通过结构化的多源信息融合,实现 Prompt + 当前输入 + 历史可用信息的有机组合。

引用链接

[1] ann-benchmarks.com: https://ann-benchmarks.com/[2] Mem0: https://github.com/mem0ai/mem0[3] Mem0 官方 benchmark 文档: https://docs.mem0.ai/core-concepts/memory-evaluation