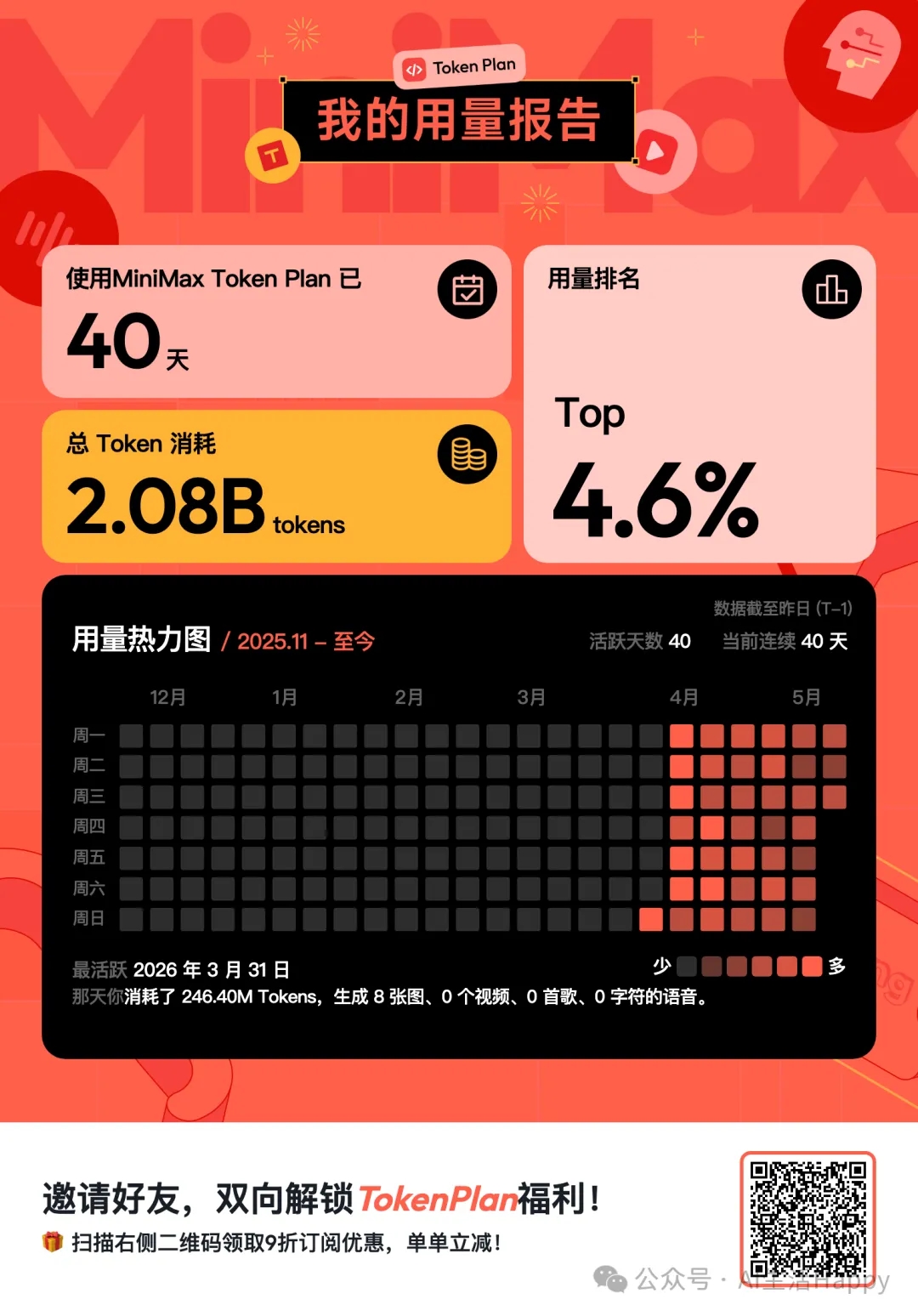

日均 5200 万,最高一天 2.46 亿。报告把我归到"用量前 4.6%"——也不知道该骄傲还是该心疼钱包。

但比起这个数字,更让我有感触的是另一件事:我用着 M2.7 的时候,模型本身还在以肉眼可见的速度进化。从 M2.5 到 M2.7,只用了一个多月。我隐隐感觉,M3 可能要比我想象中来得更快。

我的 MiniMax Token Plan 40天用量报告,连续全勤,日均 5200万 Token

先说说 M2.7 这 40 天带给我的真实感受

它真的在"自己训练自己"了

M2.7 最大的新闻不是跑分,是 MiniMax 第一次把"自我进化"做进了模型里。

具体说,M2.7 内置了一套 Agent Harness,模型能参与自己训练流程中的数据分析、实验设计、代码调试、效果评估环节。官方数据是:在部分强化学习工作流里,M2.7 能承担 30% 到 50% 的人工工作量,内部评测集上靠自我优化跑出了 30% 的效果提升。

我第一次用的时候没觉得有什么特别,但用久了发现——它处理多步骤、长链路任务的能力确实比前代稳很多。不会动不动就"迷失"或者输出到一半开始重复自己。

编程这件事,基本可以当工程师用了

SWE-bench Pro 得分 56.22%,接近国际一线。

Terminal Bench 2.0 的实测里,它能做到端到端项目交付——从理解需求、写代码、调试 Bug 到部署脚本,全流程跑通。这已经不是"帮我写几行代码"的工具了,而是真正的初级工程师工作模式。

速度也快,上下文 100K,推理跑到 100 tokens/s。一个完整的 Coding Plan 跑下来,一小时成本大概 1 美金。

多 Agent 场景,不再动不动"断片"

我同时让它处理三件不同的事:金融数据整理、代码 Debug、一篇 3000 字长文。

M2.7 能在三个角色之间来回切换,上下文边界保持清晰,没出现角色混淆。这点对我这种搞自动化工作流的人来说太重要了——之前用很多模型,多任务一跑就"断片",M2.7 基本解决了这个问题。

关于 M3,我知道些什么?

M3 还没发布,但最近几份研报把能挖的信息基本都挖出来了。

时间线:可能就在这个月

高盛最新的报告里明确预测,M3 可能在 5 月发布,而且会出两个版本——万亿参数和数千亿参数。和大摩的预测方向一致。

5-6 月这个窗口期,也是业内公认的下一个密集发布节点,和 GPT-6、谷歌 Veo4、Kimi K3 同档期。

内部消息:团队正在冲刺

5 月 6 日,MiniMax 官方客服在用户群中透露:

"还在冲刺中,五一算法一直在加班。"

从五一假期算法团队仍在加班来看,MiniMax 内部正在全力推进 M3,发布时间可能比预期更近。

大摩说:M3 之后可能要涨价

不是乱猜,年初 KV cache 价格已经翻过一次。MiniMax 2 月份 ARR 做到 1.5 亿美元,毛利率从负转正到 25.4%,商业化闭环跑通了,定价权就握在自己手里。大摩的判断是:M3 性能预期大幅提升,涨价有理。

对于重度用户来说,这反而是现在上车的理由——M3 出来之前,是最后一个价格相对低的窗口期。

高盛:M3 会是中国模型的另一个转折点

高盛最新把 MiniMax 评级从中性上调至买入,目标价 HK$1000,核心逻辑是:中国基础模型和美国 SOTA 的差距正在快速缩小,而 M3 会是下一个验证点。

"编码、多模态和任务完成率将是定价能力的驱动因素……MiniMax 即将推出的万亿参数 M3 模型将是关键观察点。"

M3 的编程能力和多模态能力,会直接决定它能不能在国际市场上站稳脚跟。

M3 可能强在哪?我的几个猜测

基于现有信息,我试着拼凑了一下 M3 可能的方向:

激活参数预计会大幅增加

M2.5/M2.7 激活参数只有 10B,这是刻意为之的效率权衡——省显存、省成本,但牺牲了知识容量。M3 要冲击"全球顶级性能",激活参数估计会到 30B-50B 这个量级,高盛报告里也暗示了万亿参数版本的存在。 多模态会是核心升级方向

从财报电话会透露的信息看,M3 会大幅强化多模态理解能力,不只是文本,而是图片、视频、语音的统一理解。这和 MiniMax"全模态"的技术路线一脉相承——他们本来就是全球少数几个文本/视频/语音/音乐/图像五个模态全部自研的厂商之一。 Hailuo 3 可能同步发

视频模型 Hailuo 目前是 V2.3 版本,在多个国际评测榜单里稳居第一梯队。和 M3 一起,MiniMax 可能推出 Hailuo 3,形成"文本+视频"的双线出击。高盛报告里也点名了这一点。 Agent 能力会更进一步

M2.7 已经实现了"模型自我参与训练",M3 预计在这个方向上走得更远——不只是辅助训练,而是更深度的自我优化。闫俊杰说过,下一步是"AI 从工具走向同事级协作",M3 应该会朝 L4 甚至 L5 的方向靠近。

为什么我现在更期待 M3 了

说实话,用 M2.7 的这 40 天,我最大的感受不是"这模型真牛",而是——

迭代速度本身,才是最大的变量。

M2 到 M2.5,用了大概一个月。M2.5 到 M2.7,又是一个多月。M3 预计上半年发。这个节奏意味着:等 M3 出来,今天 M2.7 的很多能力可能只是"及格线"。

更关键的是,M2.7 已经让我"回不去"以前的模型了。速度快、成本低、Agent 能力强——这三个条件同时满足的模型,MiniMax 是目前性价比最接近最优解的那个。

所以当我知道 M3 在架构、参数、多模态上还有大幅提升空间的时候,期待值是实打实往上走的。

20.8 亿 Token 砸进去,我最大的收获不是某一次具体的输出结果,而是真正体会到了这代模型的迭代速度。

基本上日常工作、开发任务大部分的活,我都交给了它。真希望在多模态上做得更好,推理再进一步加深。这一方面,和 GLM、DeepSeek、Qwen 3.6 以及 Kimi K2.6 相比还有差距。

M3.0 要能在这些方面赶上来,会直接对标 Claude 4.6 Opus 吧!

M3 还没来,但我已经在等它了。最后希望国产模型越来越好,突破桎梏,稳扎稳打!

与天斗,其乐无穷 与地斗,其乐无穷 与人斗,其乐无穷

—— 毛泽东