接入自定义AI提供商

只要在轻量应用服务器控制台,应用管理中将下方的自定义模型相关字段填写进去后点击保存即可完成自定义模型的配置:

MiniMax

以minimax,使用"Anthropic"协议,使用MiniMax-M2.5模型为例:

国内版 - 获取APIKey

{

"provider": "minimax",

"base_url": "https://api.minimaxi.com/anthropic",

"api": "anthropic-messages",

"api_key": "your-api-key-here",

"model": { "id": "MiniMax-M2.5", "name": "MiniMax M2.5" }

}

国际版 - 获取APIKey

{

"provider": "minimax",

"base_url": "https://api.minimax.io/anthropic",

"api": "anthropic-messages",

"api_key": "your-api-key-here",

"model": { "id": "MiniMax-M2.5", "name": "MiniMax M2.5" }

}

硅基流动

以硅基流动,使用"OpenAI"协议,使用DeepSeekv3.2模型为例:

{

"provider": "siliconflow",

"base_url": "https://api.siliconflow.cn/v1",

"api": "openai-completions",

"api_key": "your-api-key-here",

"model": {

"id": "deepseek-ai/DeepSeek-V3.2",

"name": "DeepSeek-V3.2"

}

}

Google Gemini

使用 Google Gemini API,以Gemini 3.1 Pro 模型为例:

{

"provider": "google",

"base_url": "https://generativelanguage.googleapis.com/v1beta/openai",

"api": "openai-completions",

"api_key": "your-api-key-here",

"model": {

"id": "gemini-3.1-pro-preview",

"name": "Gemini 3.1 Pro"

}

}

OpenAI (GPT)

官方文档:https://developers.openai.com/api/docs

使用 OpenAI 官方 API,以最新的 GPT-5.2 模型为例:

{

"provider": "openai",

"base_url": "https://api.openai.com/v1",

"api": "openai-completions",

"api_key": "your-api-key-here",

"model": {

"id": "gpt-5.2",

"name": "GPT-5.2"

}

}

Anthropic Claude

官方文档:https://platform.claude.com/docs/zh-CN/home

使用 Anthropic Claude API,以最新的 Claude Opus 4.6 模型为例:

{

"provider": "anthropic",

"base_url": "https://api.anthropic.com",

"api": "anthropic-messages",

"api_key": "your-api-key-here",

"model": {

"id": "claude-opus-4-6",

"name": "Claude Opus 4.6"

}

}

xAI Grok

使用 xAI Grok API(兼容 OpenAI 协议),以最新的 Grok 4.1 模型为例:

{

"provider": "xai",

"base_url": "https://api.x.ai/v1",

"api": "openai-completions",

"api_key": "your-api-key-here",

"model": {

"id": "grok-4.1",

"name": "Grok 4.1"

}

}

OpenRouter

使用 OpenRouter API(兼容 OpenAI 协议),以NVIDIA: Nemotron 3 Nano 30B A3B 模型(限时免费)为例:

{

"provider": "openrouter",

"base_url": "https://openrouter.ai/api/v1",

"api": "openai-completions",

"api_key": "your-api-key-here",

"model": {

"id": "nvidia/nemotron-3-nano-30b-a3b:free",

"name": "NVIDIA: Nemotron 3 Nano 30B A3B"

}

}

通用配置模板

如果上述没有你想要的模型,可以使用以下通用模板接入任何兼容OpenAI/Anthropic协议的模型:

{

"provider": "provider_name",

"base_url": "baseurl",

"api": "API协议",

"api_key": "your-api-key-here",

"model": {

"id": "model_id",

"name": "model_name"

}

}

单次配置多个模型

{

"provider": "provider_name",

"base_url": "baseurl",

"api": "API协议",

"api_key": "your-api-key-here",

"model": [{

"id": "model1",

"name": "model1"

},{

"id": "model2",

"name": "model2"

},{

"id": "model3",

"name": "model3"

},{

"id": "model4",

"name": "model4"

}]

}

参数说明

参数 | 说明 | 示例 |

|---|---|---|

| 提供商名称,自定义即可 |

|

| API 基础地址 |

|

| API 协议类型: |

|

| 提供商的 API 密钥 |

|

| 模型的唯一标识符 |

|

| 模型的显示名称 |

|

常见问题

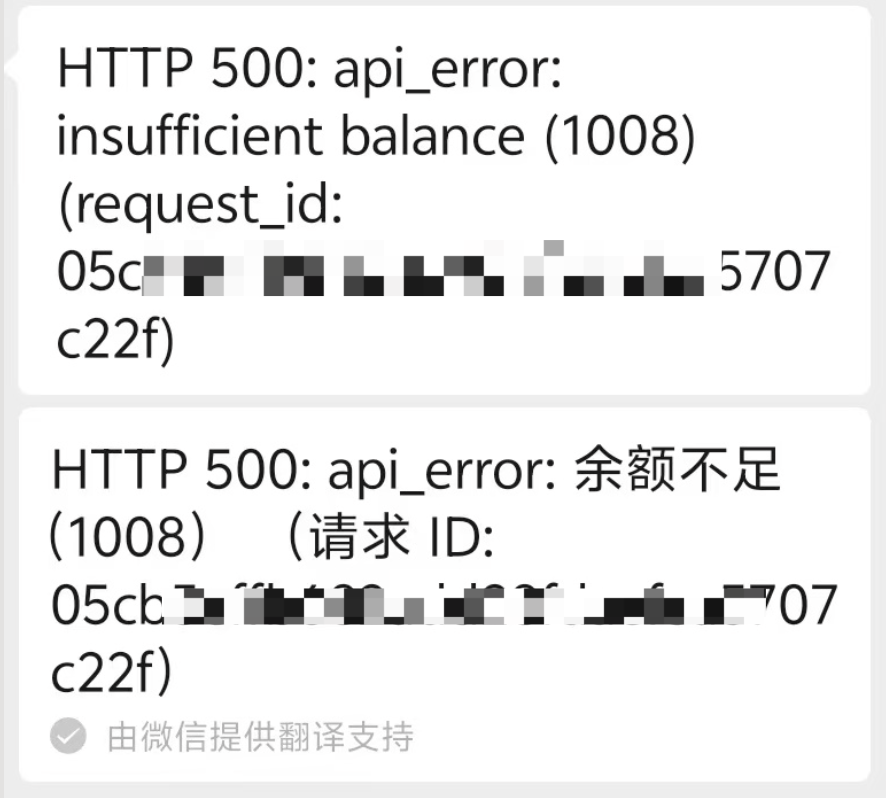

报错(错误码相关)

99%的错误码都可以通过长按翻译了解原因

常见错误码

错误码因提供商不同可能略有出入,仅供参考。

错误码 | 原因 | 解决方案 |

|---|---|---|

401 not authorized | apikey不正确 | 前往模型提供商检查写入的APIKey是否正确 |

429/500 | 余额不足 | 充钱或检查APIKey是否正确 |

rate_limit | 速率限制 | 更换提供商,或联系提供商获取更大配额 名词释义: RPM(Requests Per Minute)表示每分钟请求数。 TPM(Tokens Per Minute)表示每分钟处理的Tokens数量。 |

404 | baseurl不对 | 查看提供商文档寻找兼容 OpenAI Chat Completions API 或 Anthropic Messages API 的baseurl地址 |

403 | 该模型不支持此服务器地域 | 更换服务器地域为模型支持的地域或更换模型 |

模型回复慢(响应慢)

若您选择的轻量应用服务器为境外地域且使用境内通道/模型提供商可能会因跨境网络原因导致延迟较高。

若您选择深度思考模型可能因上下文过多导致模型思考时间过长,推荐您选择非思考模型/快思考模型进行替代。

Token消耗过快

OpenClaw 在调用模型时会携带较多上下文信息,以保证任务连贯性与准确性,因此 Token 消耗可能较高。建议在使用时关注 Token 用量与计费情况