前言:为什么需要配置模型?

LightClaw 是一个自托管的 AI 个人助手 —— 这意味着它运行在你自己的设备上,你拥有完全的数据控制权。但要让 LightClaw 真正"活"起来,你需要告诉它该调用哪个大语言模型(LLM)来思考和回答问题。

你可以把 LightClaw 想象成一副精密的钢铁侠战甲 🦾,而大模型就是里面的 J.A.R.V.I.S.。没有接入大模型的 LightClaw,就像一副空壳盔甲 —— 好看但不会动。

好消息是,LightClaw 支持超多模型提供商:腾讯云、DeepSeek、百炼、火山引擎、智谱 AI、OpenAI、Anthropic、Google Gemini 等等,甚至还能接入你自己部署的本地模型(Ollama)。选择困难症患者别慌,跟着教程来就对了!

Part 1:进入引导页

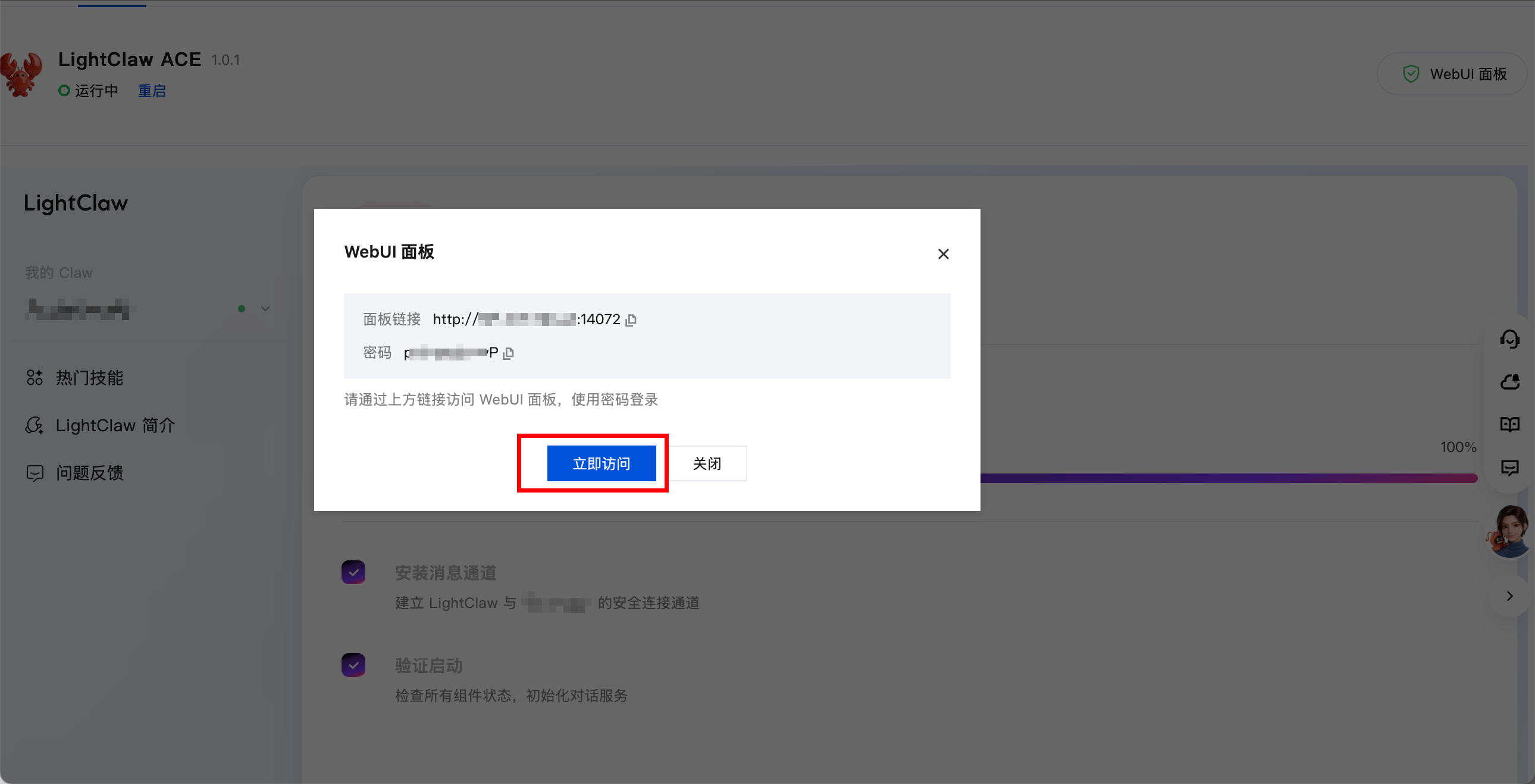

Step 1:找到 WebUI 面板入口

安装并启动 LightClaw 后,你会看到 LightClaw ACE 的主管理界面。注意右上角 —— 那里有一个醒目的 「WebUI 面板」 按钮,它就是通往配置世界的大门。

💡 提示:确保 LightClaw 状态显示为 "运行中"(左上角绿色圆点),这表示后端服务已经成功启动。如果看到红色或黄色状态,请先排查启动问题。

Step 2:获取面板地址并访问

点击「WebUI 面板」按钮后,会弹出一个对话框,显示:

面板链接:你的 WebUI 访问地址(如

http://XXX.XXX.XXX.XX:14072)密码:系统自动生成的登录密码

点击 「立即访问」 按钮,浏览器将自动打开 WebUI 面板。

🔐 安全提示:请妥善保管你的面板链接和密码。如果是公网 IP,建议尽快在引导页中修改为强密码。密码旁边有复制按钮,点击即可复制到剪贴板。

Part 2:在引导页中配置模型

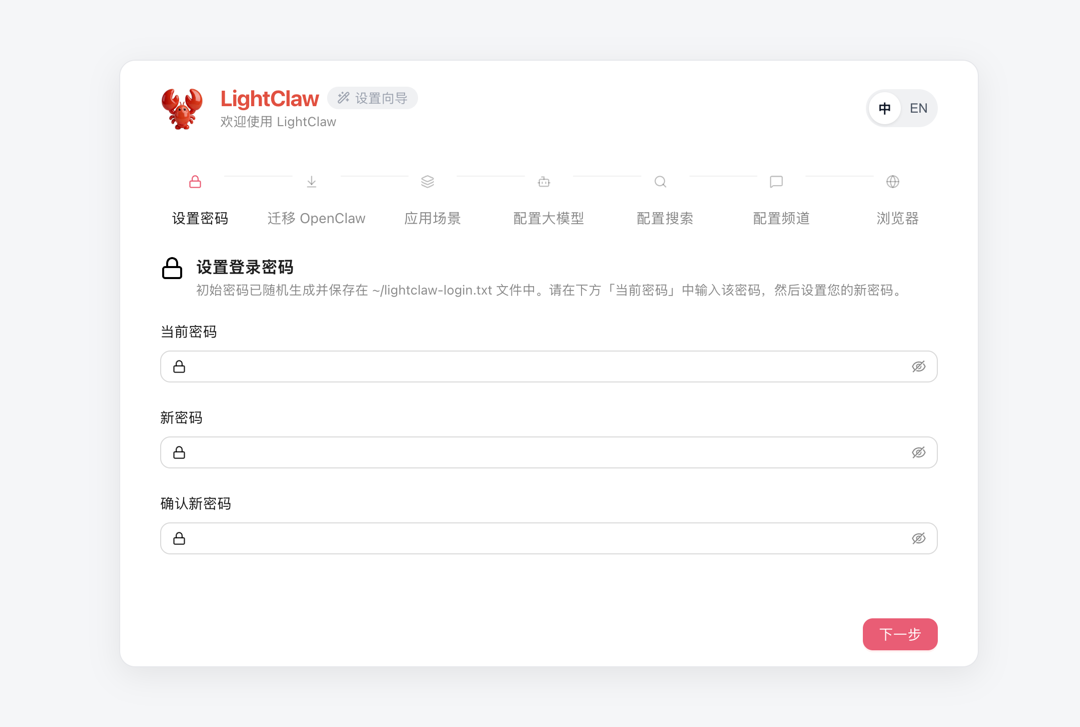

当你首次访问 WebUI 面板时,LightClaw 会贴心地启动一个 「设置向导」,引导你完成所有初始配置。接下来,我们重点关注大模型配置这一环节。

Step 3:进入设置向导

成功访问 WebUI 后,你将看到设置向导页面。顶部的导航条清晰展示了所有配置步骤:

设置密码 → 迁移 OpenClaw → 应用场景 → 配置大模型 → 配置搜索 → 配置频道 → 浏览器

首先完成密码设置(输入当前密码,设置新密码),然后点击 「下一步」 逐步前进,直到来到 「配置大模型」 步骤。

📝 备注:初始密码已随机生成并保存在

~/lightclaw-login.txt文件中。请在「当前密码」栏填入该密码,然后设置你自己的新密码。

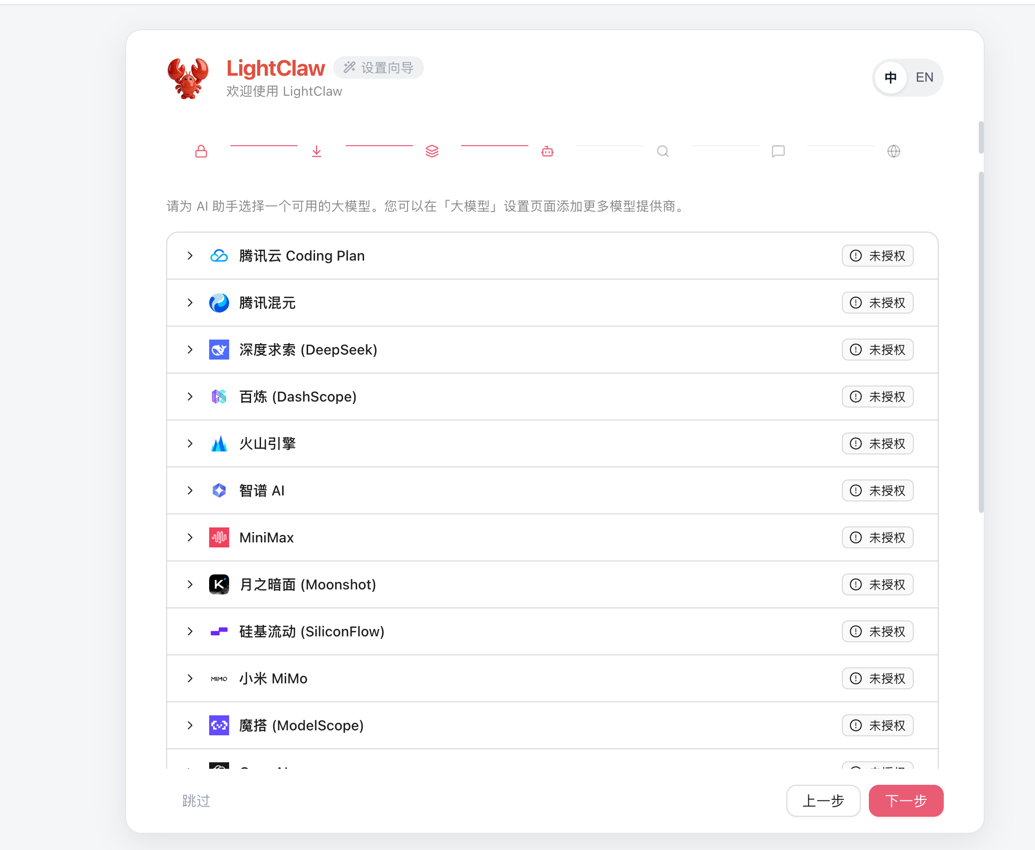

Step 4:浏览模型提供商列表

来到「配置大模型」步骤,你会看到一个壮观的提供商列表 —— LightClaw 内置支持了众多主流大模型平台:

| 提供商 | 说明 |

|---|---|

| 🔵 腾讯云 Coding Plan | 腾讯云编程专用模型 |

| 🟣 腾讯混元 | 腾讯自研通用大模型 |

| 🟢 深度求索 (DeepSeek) | 高性价比推理模型 |

| 🔶 百炼 (DashScope) | 阿里云模型服务 |

| 🌋 火山引擎 | 字节跳动模型平台 |

| 💎 智谱 AI | 清华系 GLM 模型 |

| 🎵 MiniMax | 多模态大模型 |

| 🌙 月之暗面 (Moonshot) | Kimi 背后的模型 |

| ⚡ 硅基流动 (SiliconFlow) | 模型推理加速平台 |

| 📱 小米 MiMo | 小米自研模型 |

| 🏗️ 魔搭 (ModelScope) | 模型社区平台 |

每个提供商右侧都显示了当前的授权状态(「已授权」或「未授权」)。

🎯 该选谁? 如果你是新手,推荐先试试 腾讯云 Coding Plan(额度友好)或 DeepSeek(性价比之王)。当然,你完全可以同时配置多个提供商,按需切换!

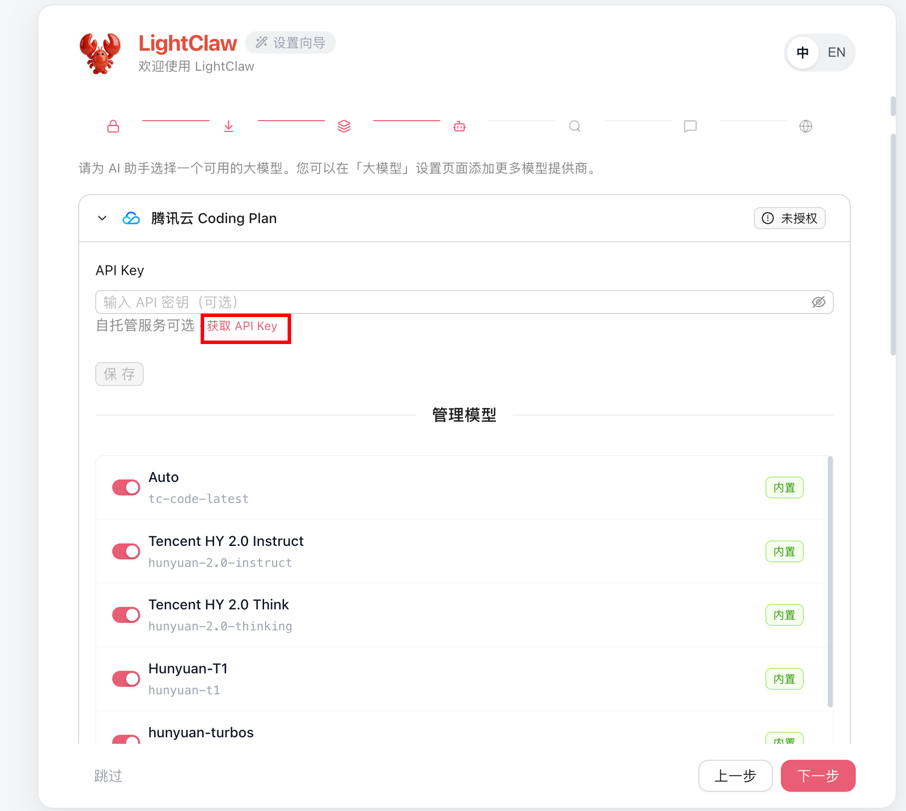

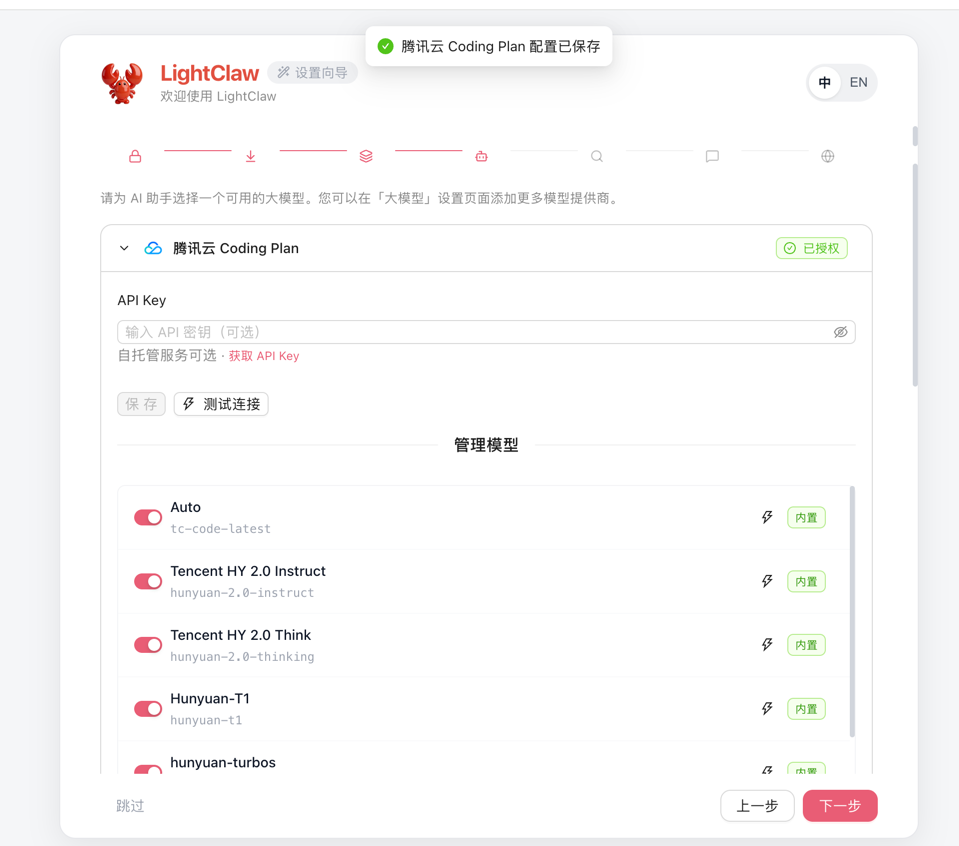

Step 5:配置内置提供商(以腾讯云 Coding Plan 为例)

点击你想配置的提供商名称(这里以「腾讯云 Coding Plan」为例),展开后会显示:

API Key 输入框:填入你的 API 密钥

获取 API Key 链接:点击可跳转到官方平台申请密钥

管理模型 区域:展示该提供商下所有可用模型及开关状态

操作步骤:

点击 「获取 API Key」 链接,前往腾讯云官网注册并获取 API 密钥

将获取到的 API Key 粘贴到输入框中

在下方「管理模型」区域,你可以看到该提供商内置的所有模型(如 Auto、Tencent HY 2.0 Instruct、Tencent HY 2.0 Think、Hunyuan-T1 等),通过开关控制启用/禁用

🔑 小贴士:API Key 是你与模型提供商之间的"通行证"。每个提供商的 Key 获取方式不同,点击「获取 API Key」会引导你到对应平台。部分提供商(如腾讯云 Coding Plan)标注了"自托管服务可选",意味着如果你使用的是自托管版本,可能无需手动输入 Key。

Step 6:保存配置

填入 API Key 后,点击 「保存」 按钮。保存成功后,你将看到:

顶部弹出绿色提示:"腾讯云 Coding Plan 配置已保存" ✅

提供商状态从「未授权」变为 「已授权」(绿色标签)

模型列表中的开关变为可操作状态

恭喜!你已经成功接入了第一个大模型提供商 🎉

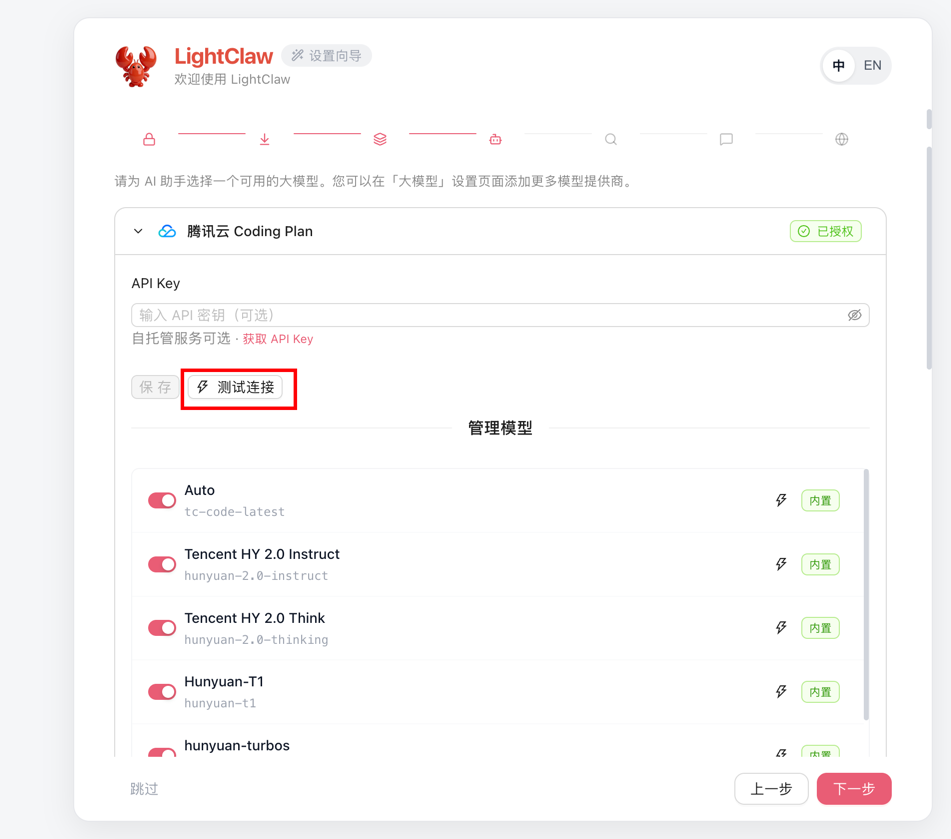

Step 7:测试连接

配置保存后,别急着离开 —— 我们来验证一下连接是否真的通了。找到 「⚡ 测试连接」 按钮并点击它。

🧪 为什么要测试? 就像买了新手机要先开机验一下,测试连接能帮你确认 API Key 是否正确、网络是否畅通、服务是否正常。磨刀不误砍柴工!

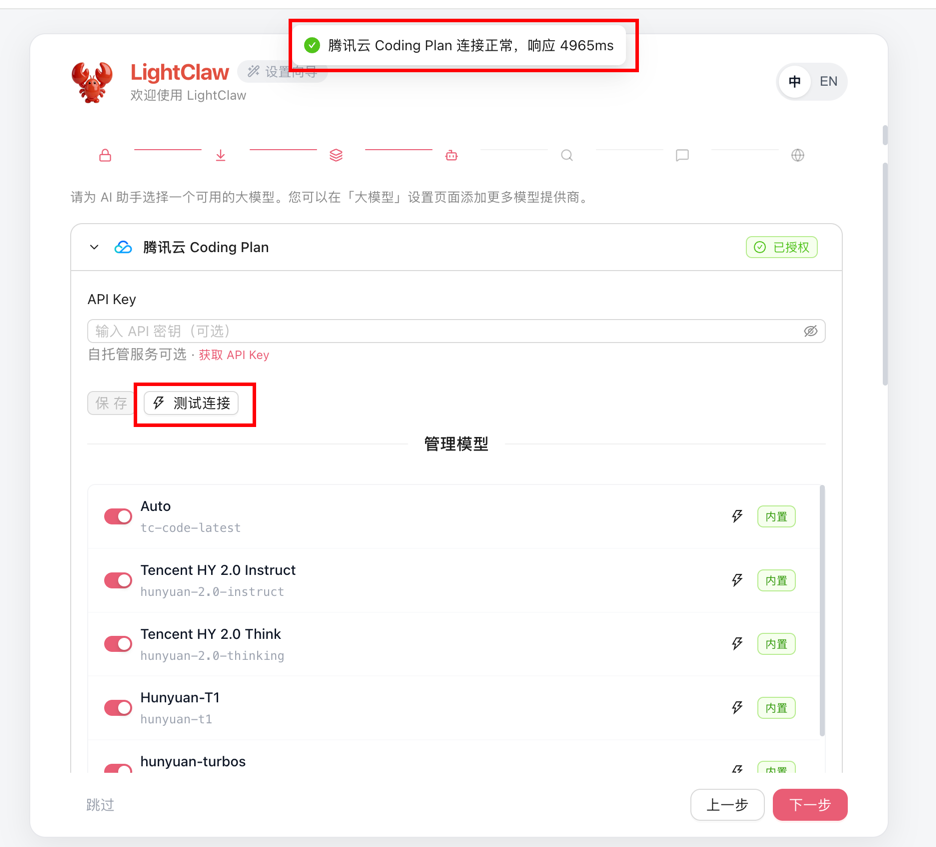

Step 8:确认连接成功

如果一切配置正确,你会在顶部看到一条令人愉悦的绿色提示:

"✅ 腾讯云 Coding Plan 连接正常,响应 4965ms"

这意味着你的 LightClaw 已经成功与腾讯云 Coding Plan "握手"了!响应时间(4965ms)是首次连接的延迟,后续对话会更快。

⚠️ 如果连接失败? 请检查:① API Key 是否正确复制(注意首尾空格);② 网络是否能访问该提供商的 API 地址;③ API Key 是否已过期或额度用完。

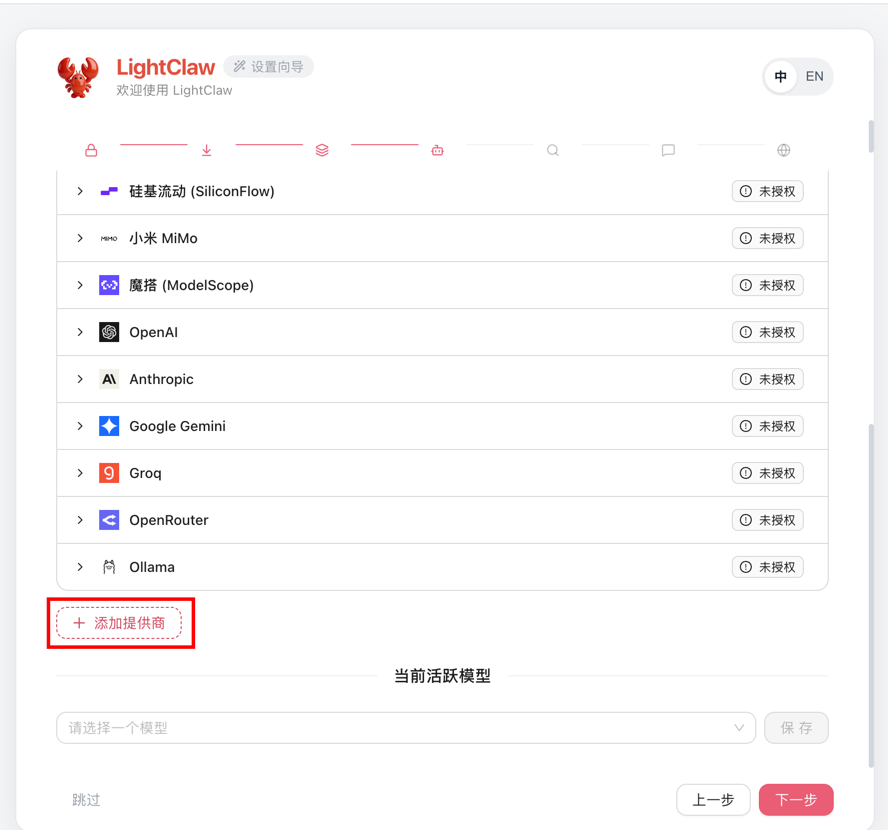

Step 9:添加自定义提供商

如果内置列表中没有你想用的模型平台怎么办?别担心!向下滚动到列表底部,你会发现一个 「+ 添加提供商」 按钮。

注意,在内置提供商列表中还包括了国际主流平台:OpenAI、Anthropic、Google Gemini、Groq、OpenRouter、Ollama 等。如果你要接入的恰好在列表中,直接展开配置即可。

对于任何兼容 OpenAI API 格式的第三方平台,都可以通过「添加提供商」来接入。

Step 10:填写自定义提供商信息

点击「+ 添加提供商」后,会展开一个表单,需要填写以下信息:

| 字段 | 说明 | 示例 |

|---|---|---|

| 提供商 ID (必填) | 唯一标识符,仅支持小写字母、数字、连字符、下划线,创建后不可更改 | hai |

| 显示名称 (必填) | 在界面上显示的名称 | hai |

| 默认接入地址 | 该提供商的 API Base URL | https://api.haihub.cn/v1 |

| API 密钥 | 你的 API Key(可选,可稍后设置) | sk-xxxxx |

填写完基本信息后,你可以看到下方的「初始模型」区域和 「+ 添加模型」 按钮。

📌 提供商 ID 命名建议:使用简短、有辨识度的英文名称,如

deepseek、moonshot、my-local等。记住:一旦创建,ID 就不能再改了哦!

Step 11:为自定义提供商添加模型

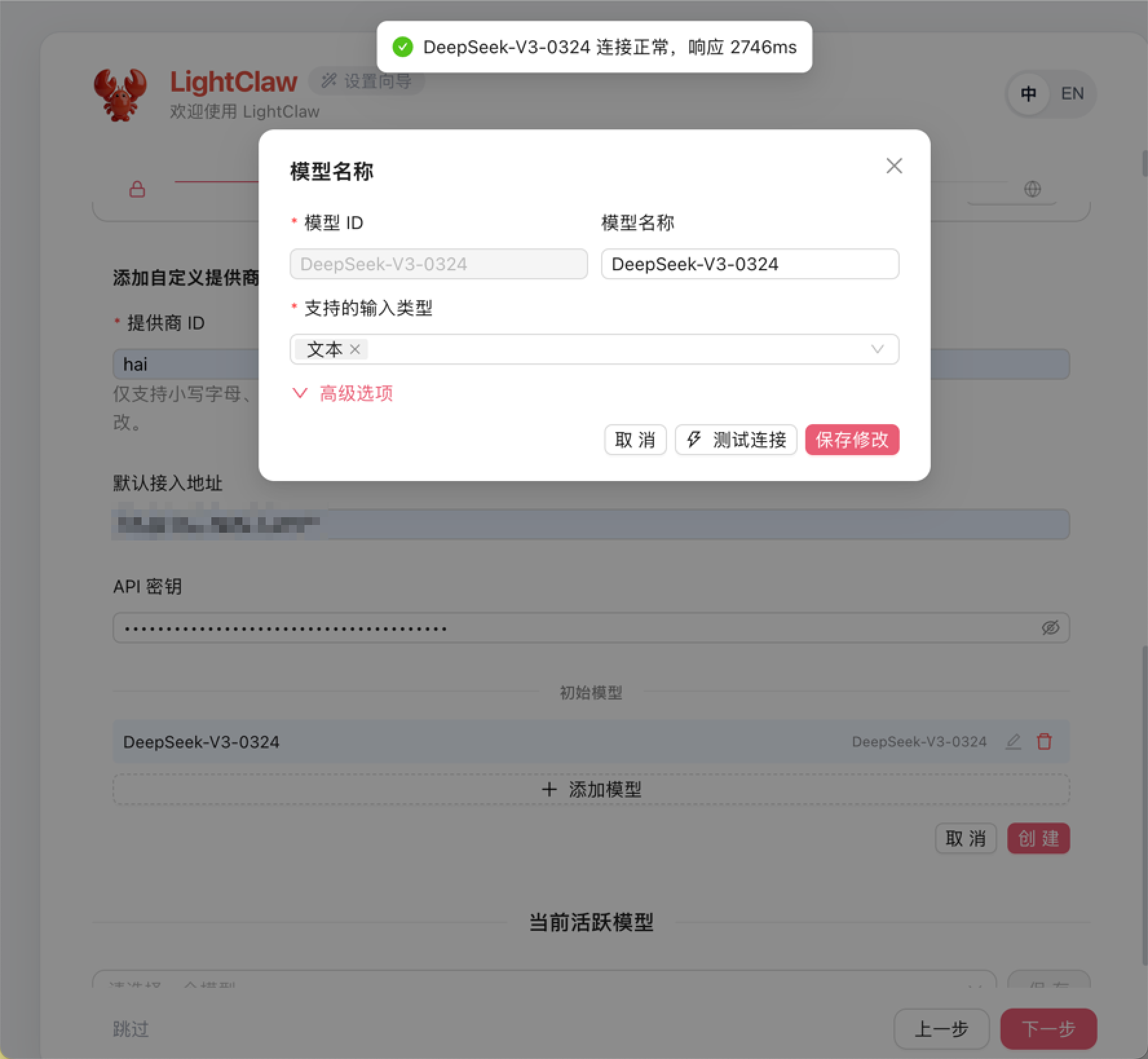

点击 「+ 添加模型」 按钮,弹出模型添加对话框:

需要填写:

| 字段 | 说明 | 示例 |

|---|---|---|

| 模型 ID (必填) | 模型的唯一标识符(通常与API调用时的model参数一致) | DeepSeek-V3-0324 |

| 模型名称 | 在界面上显示的友好名称 | DeepSeek-V3-0324 |

| 支持的输入类型 (必填) | 该模型支持处理的数据类型 | 文本 |

你还可以展开 「高级选项」 进行更精细的配置。

填完后,强烈建议先点击 「⚡ 测试连接」 验证模型是否可用,然后再点击 「添加模型」。

Step 12:测试并保存模型

点击测试连接后,看到绿色提示 —— 大功告成!

"✅ DeepSeek-V3-0324 连接正常,响应 2746ms"

确认连接正常后,点击 「保存修改」 按钮保存模型配置。此时你可以看到初始模型列表中已经出现了刚添加的 DeepSeek-V3-0324,旁边有编辑(✏️)和删除(🗑️)按钮。

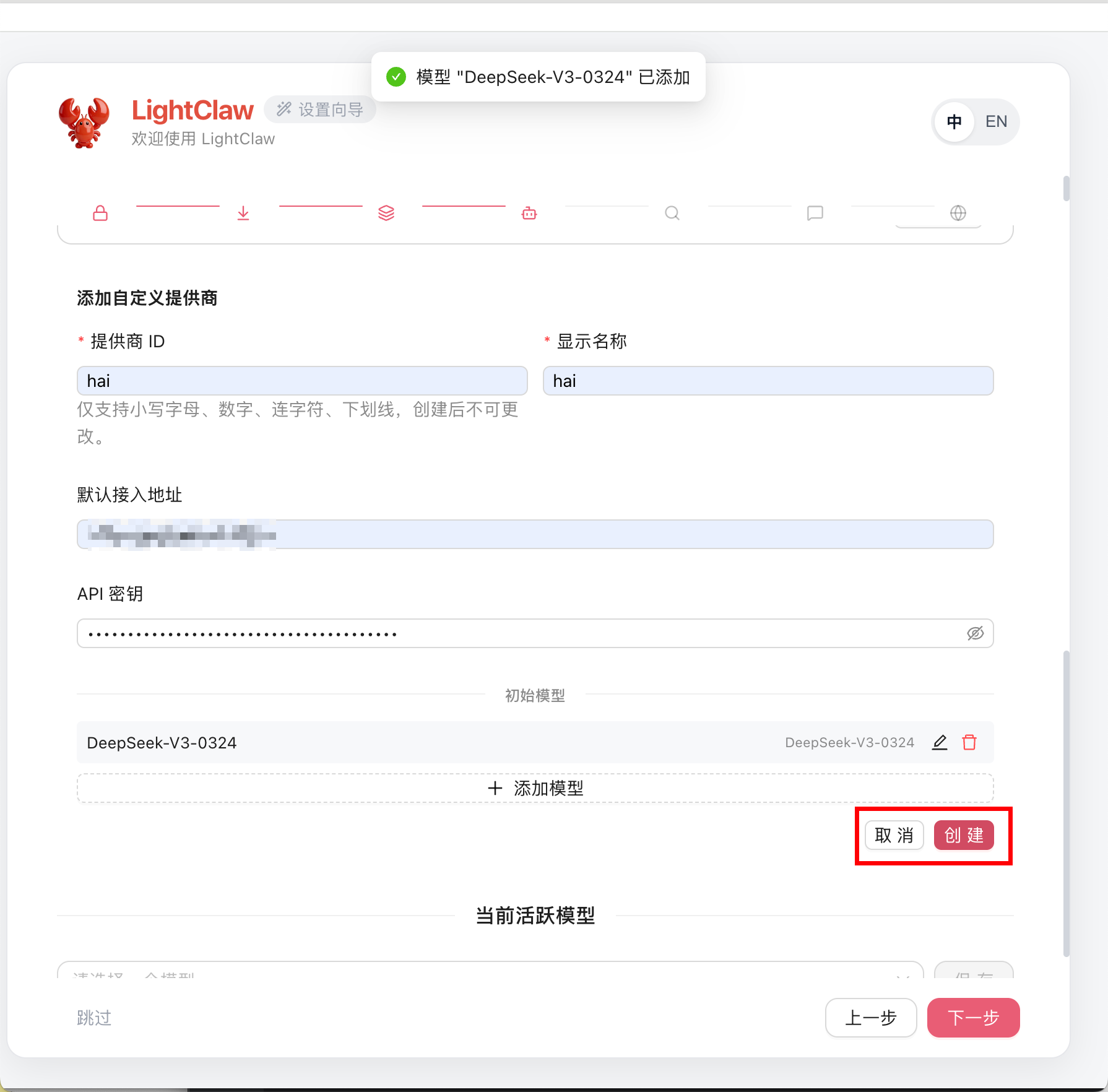

Step 13:完成自定义提供商创建

所有信息填写完毕、模型添加完成后,点击右下角的 「创建」 按钮,正式创建这个自定义提供商。

顶部会弹出成功提示:"✅ 模型 "DeepSeek-V3-0324" 已添加"

🎊 恭喜! 你已经成功添加了一个自定义模型提供商!现在你可以继续点击「下一步」完成剩余的引导配置,或点击「跳过」直接开始使用。

Part 3:在 WebUI 面板中管理模型

引导页配置完成后,日常的模型管理工作可以在 WebUI 面板 中随时进行。无论是新增提供商、修改 API Key,还是启用/禁用模型,都能一键搞定。

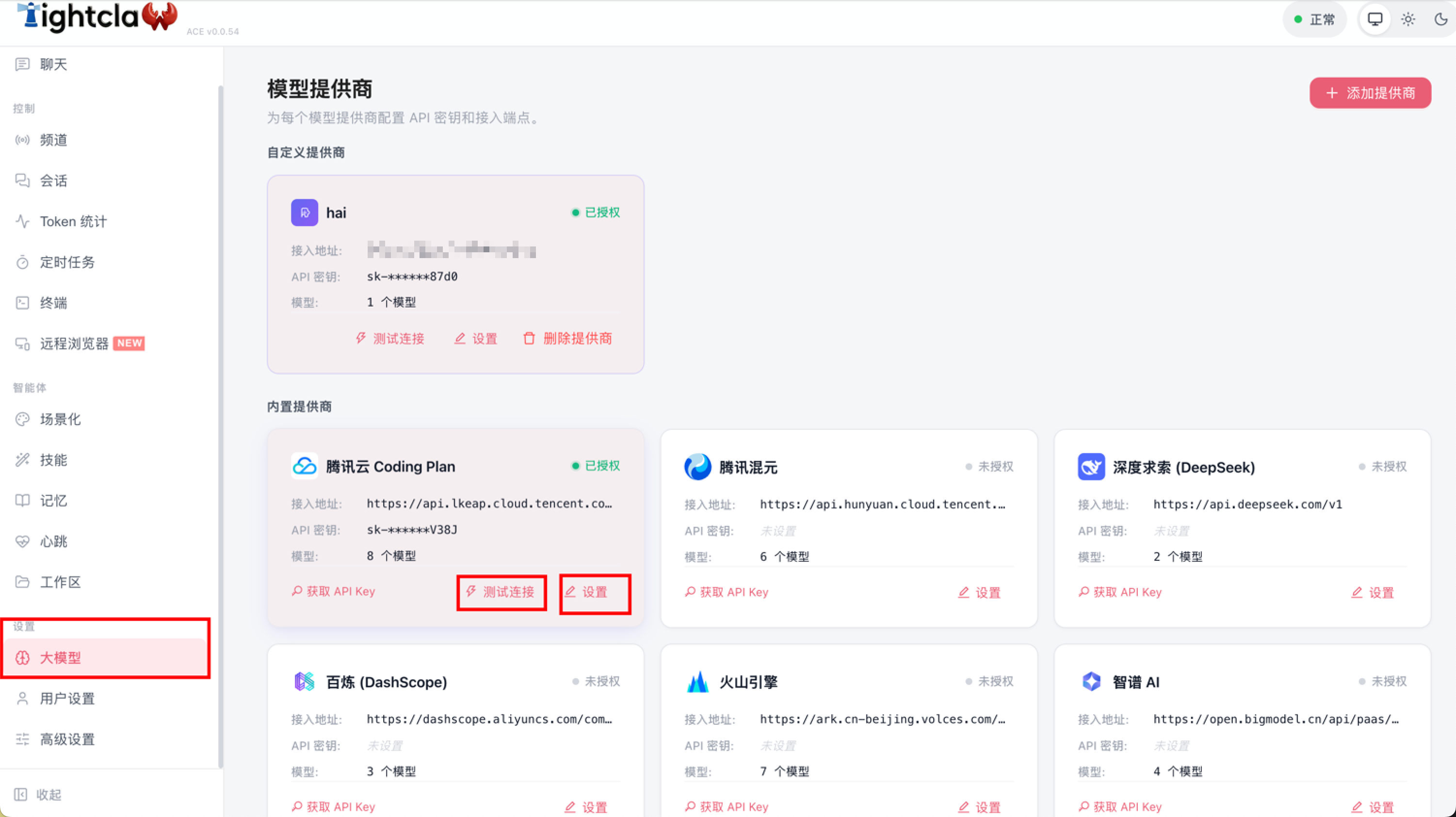

Step 14:进入大模型设置页

在 WebUI 面板的左侧导航栏中,找到 「设置」 分组下的 「大模型」 菜单项并点击进入。

这里以卡片形式清晰展示了所有已配置的模型提供商,分为两个区域:

🔧 自定义提供商(你手动添加的):

显示接入地址、API 密钥(已脱敏)、模型数量

提供「测试连接」「设置」「删除提供商」操作

📦 内置提供商(系统预置的):

腾讯云 Coding Plan、腾讯混元、DeepSeek、百炼、火山引擎、智谱 AI 等

每张卡片显示授权状态(绿色「已授权」/ 灰色「未授权」)

提供「获取 API Key」「测试连接」「设置」操作

右上角还有 「+ 添加提供商」 按钮,随时可以接入新平台。

🗂️ 一目了然:这个页面就是你的"模型指挥中心",所有提供商的状态一览无余。绿色圆点 = 已授权可用,灰色 = 还需配置。

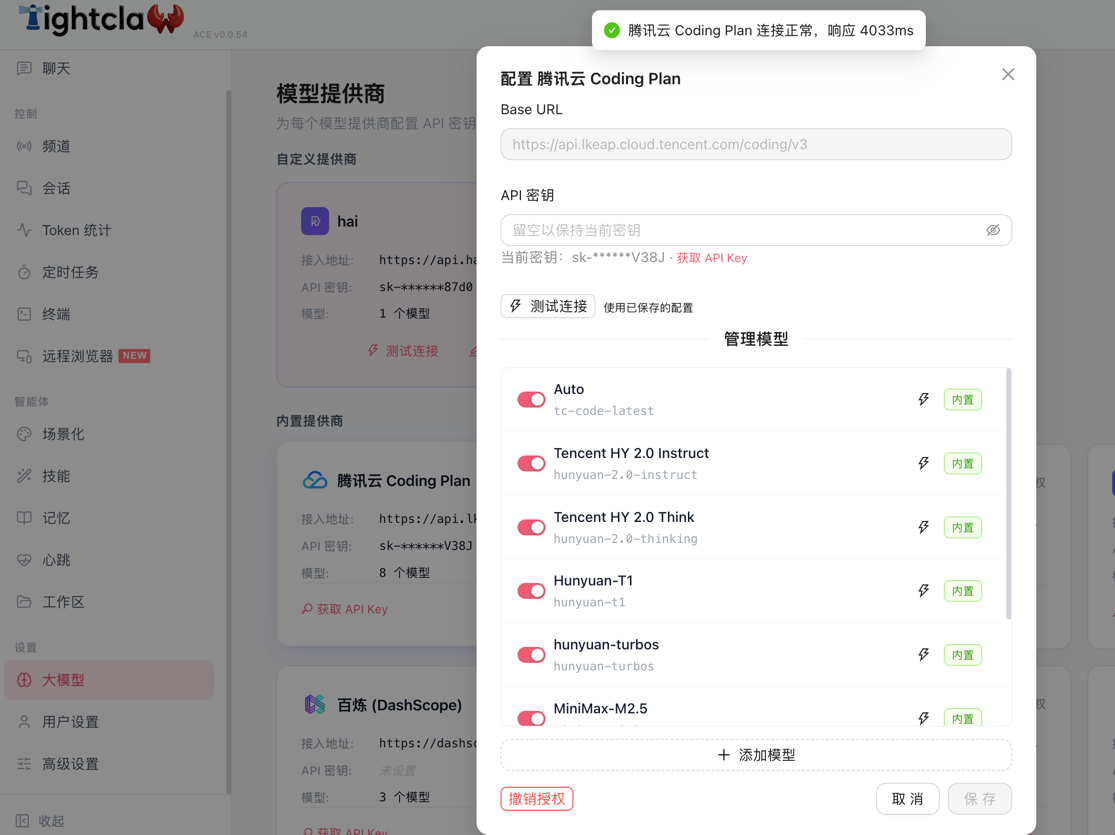

Step 15:管理已有提供商的模型

点击任意提供商卡片上的 「设置」 按钮,会弹出详细配置面板。以「腾讯云 Coding Plan」为例:

在这个面板中,你可以:

| 操作 | 说明 |

|---|---|

| 修改 Base URL | 更改 API 接入地址(一般无需改动) |

| 更新 API 密钥 | 替换为新的 API Key(留空则保持当前密钥) |

| ⚡ 测试连接 | 随时验证连接状态(如图显示"响应 4033ms") |

| 管理模型 | 通过开关启用/禁用各个模型 |

| + 添加模型 | 为该提供商添加新模型 |

| 撤销授权 | 移除该提供商的授权信息 |

你可以看到模型列表中包括 Auto、Tencent HY 2.0 Instruct、Tencent HY 2.0 Think、Hunyuan-T1、hunyuan-turbos、MiniMax-M2.5 等多个模型,每个模型旁边都有开关和编辑按钮,可以灵活控制。

💡 进阶玩法:你可以同时启用多个提供商和模型,然后在聊天时按需切换。比如日常闲聊用 DeepSeek(省钱),写代码用腾讯云 Coding Plan(专业),写长文用 Claude(质量高)。多管齐下,各取所长!

常见问题 FAQ

❓ Q1:我可以同时配置多个提供商吗?

当然可以! LightClaw 支持同时配置任意数量的模型提供商。你可以在聊天时灵活切换使用不同的模型。

❓ Q2:API Key 存储安全吗?

所有 API Key 都本地存储在你设备的 ~/.lightclaw/lightclaw.json 配置文件中,不会上传到任何第三方服务器。这就是自托管的魅力所在!

❓ Q3:如何接入本地部署的模型(如 Ollama)?

在提供商列表中找到 Ollama,展开配置。默认接入地址通常是 http://localhost:11434。如果你的 Ollama 运行在其他端口或远程机器上,修改为对应地址即可。不需要 API Key。

❓ Q4:测试连接成功,但聊天时报错怎么办?

检查你使用的具体模型是否已启用(开关是否打开)

确认 API Key 有足够的余额/配额

查看 LightClaw 后端日志(终端页面或

lightclaw.log)获取详细错误信息

❓ Q5:引导页跳过了,还能重新配置吗?

完全没问题! 即使跳过了引导页,你随时都可以通过 WebUI 面板左侧的 「大模型」 菜单进行配置和管理(即 Part 3 的内容)。

总结

让我们回顾一下整个配置流程:

🚀 启动 LightClaw

└─ 📺 点击「WebUI 面板」进入引导页

└─ 🔑 设置密码

└─ 🧠 配置大模型

├─ 📋 选择内置提供商 → 填入 API Key → 保存 → 测试连接

└─ ➕ 添加自定义提供商 → 填写信息 → 添加模型 → 创建

└─ 🎛️ 日常管理:WebUI 面板 → 设置 → 大模型 → 随时调整

三句话总结:

内置提供商:展开 → 填 Key → 保存 → 测试 → 搞定!

自定义提供商:添加 → 填信息 → 加模型 → 创建 → 搞定!

日常管理:面板 → 大模型 → 想改就改!

现在,你的 LightClaw 已经拥有了一颗强大的 AI 大脑。快去和你的 AI 助手聊聊天吧!🐾✨